इंसानों को जिस बात से सबसे ज़्यादा डर लगता है वही हो गया है।

मैं इंटरनेट पर बेतरतीब ढंग से कुछ समाचार लेख पढ़ता हूं, लेकिन मैं यह नहीं बता सकता कि वे एआई या इंसानों द्वारा बनाए गए हैं। जब मैं अपने खाली समय में गेम खेलता हूं, तो मैं यह नहीं बता सकता कि मेरे टीम के साथी एआई इंसान हैं या वास्तविक लोग।

लाइव प्रसारण कक्ष में, डिजिटल मशहूर हस्तियों ने अपने दम पर मुर्गों के पैरों को चूसा, जिससे एक ऐसा दृश्य बन गया जो चिल्ला रहे वास्तविक व्यक्ति सहायकों से अलग हो गया था…

विदेशी मीडिया 404 मीडिया के अनुसार, वर्डफ़्रेक, एक परियोजना जो मूल रूप से कई भाषाओं में विभिन्न शब्दों और शब्दावली के उपयोग की लोकप्रियता और आवृत्ति को ट्रैक और विश्लेषण करने के लिए उपयोग की जाती थी, अब नवीनतम शिकार बन गई है।

जहां सूरज चमकता है, वहां हमेशा एक छाया छिपी रहती है, और यह स्पष्ट है कि वर्डफ़्रेक पहला शिकार नहीं है, न ही यह आखिरी होगा।

दूसरे शब्दों में, यह स्वयं मनुष्य ही हो सकते हैं जो अंततः इसके लिए भुगतान करते हैं।

जीपीटी भाषा को प्रदूषित करता है और इंसानों को इसकी कीमत चुकानी पड़ती है

"जेनरेटिव एआई ने डेटा को प्रदूषित कर दिया है, और मुझे नहीं लगता कि 2021 के बाद किसी के पास मानव भाषा के उपयोग के बारे में विश्वसनीय जानकारी है।"

वर्डफ़्रेक प्रोजेक्ट के संस्थापक रॉबिन स्पीयर के हृदय से निकली यह पुकार थोड़ी असहायता और आक्रोश को प्रकट करती है।

इसके पीछे का कारण जानने के लिए हमें Wordfreq की उत्पत्ति से शुरुआत करनी होगी।

विकिपीडिया, फिल्म और टीवी उपशीर्षक, समाचार रिपोर्ट और रेडिट जैसी वेबसाइटों की सामग्री का विश्लेषण करके, वर्डफ़्रेक 40 से अधिक भाषाओं के विकास को ट्रैक करने का प्रयास करता है, और फिर स्लैंग और पॉप संस्कृति में बदलाव के रूप में बदलती भाषा की आदतों का अध्ययन करता है।

वर्डफ़्रीक भाषाविदों, लेखकों और अनुवादकों के लिए एक खजाना है। लेकिन अब, GitHub पते पर एक बड़ा बयान "यह प्रोजेक्ट अब अपडेट नहीं किया जाएगा" ने दुखद रूप से इस प्रोजेक्ट के लिए मौत की घंटी बजा दी है।

अतीत में, वेब से सार्वजनिक डेटा को स्क्रैप करना परियोजना के डेटा स्रोत की जीवनरेखा थी, लेकिन जेनरेटिव एआई के उदय ने एआई टेक्स्ट को लोकप्रिय बना दिया है।

स्पीयर ने एक विशिष्ट उदाहरण दिया। अतीत में, लोग शायद ही कभी "डेलवे" शब्द का उपयोग करते थे, हालांकि, जैसे ही चैटजीपीटी ने इस शब्द को एक मंत्र में बदल दिया, ली गुई द्वारा ली कुई का प्रतिरूपण करने की अधिक संभावना हो गई, जो कभी-कभी शब्द आवृत्ति आंकड़ों को विकृत कर देता है मानव भाषा की आदतों का सटीक विश्लेषण।

यदि यह पर्याप्त रूप से सहज ज्ञान युक्त नहीं है, तो "संक्षेप में" और "संक्षेप में" जैसे क्लिच का प्रसार सबसे हड़ताली चेतावनी है।

यह प्रवृत्ति धीरे-धीरे अकादमिक लेखन और यहां तक कि साहित्यिक सृजन में भी प्रवेश कर रही है।

स्टैनफोर्ड यूनिवर्सिटी की एक रिपोर्ट में बताया गया है कि चैटजीपीटी केवल पांच महीनों में कई विशेषज्ञों और विद्वानों के लिए "लेखन कलाकृति" बन गया है। उनमें से, कंप्यूटर विज्ञान के क्षेत्र में, लगभग हर छह सार और हर सात परिचय उनके द्वारा लिखे गए हैं।

जेनेरिक एआई द्वारा मानव लेखन शैली पर "बड़े पैमाने पर आक्रमण" इस प्रकार है।

इटालियन इंस्टीट्यूट फॉर इंटरनेशनल एडवांस्ड स्टडीज के डॉक्टरेट छात्र गेंग मिंगमेंग के शोध परिणाम एक दर्पण की तरह हैं, जो चैटजीपीटी की शब्द प्राथमिकताओं को दर्शाते हैं और अकादमिक पेपर लेखन में इसके प्रभाव की पूरी तरह से पुष्टि करते हैं।

arXiv पर दस लाख से अधिक कागजात के सार का विश्लेषण करने के बाद, गेंग मिंगमेंग ने पाया कि चैटजीपीटी की लोकप्रियता के बाद कागजात की शब्द आवृत्ति में काफी बदलाव आया है। उनमें से, "महत्वपूर्ण" जैसे शब्दों के उपयोग की आवृत्ति में काफी वृद्धि हुई है, जबकि "है" और "हैं" जैसे शब्दों के उपयोग की आवृत्ति में लगभग 10% की कमी आई है।

ज्यादातर मामलों में, जेनरेटिव एआई 60 के रचनात्मकता स्कोर वाले व्यक्ति को 70 या उससे अधिक के स्कोर में बदल सकता है, हालांकि, पाठ निर्माण में, हालांकि व्यक्तिगत रचनात्मकता और लेखन की गुणवत्ता में सुधार हुआ है, इसने सामूहिक रचनात्मकता को अदृश्य रूप से कम कर दिया है .

यूसीएल और एक्सेटर विश्वविद्यालय के दो शिक्षाविदों ने विज्ञान में एक अध्ययन प्रकाशित किया जिसमें 500 प्रतिभागियों को यादृच्छिक विषयों पर कहानियों की लगभग 8 पंक्तियाँ लिखने और लक्षित दर्शकों का विश्लेषण करने के लिए एआई का उपयोग करने का काम सौंपा गया था।

नतीजों से पता चला कि एआई प्रेरणा की मदद से कहानियां अधिक "रचनात्मक" हो गईं, लेकिन इन एआई द्वारा उत्पन्न कहानियां भी आश्चर्यजनक रूप से एक-दूसरे के समान थीं।

इसलिए, जब जेनरेटिव एआई टेक्स्ट वर्डफ्रीक और मनुष्यों के लिए एक व्यापक प्रदूषक की तरह इंटरनेट में बाढ़ आ जाता है, तो लाभ नुकसान से कहीं अधिक होता है।

क्रॉलर विरोधी युद्ध शुरू, वर्डफ़्रेक पीड़ित

वर्डफ़्रेक परियोजना की समाप्ति को विशाल क्रॉलर युद्ध में फंसे शिकार के रूप में माना जा सकता है।

एआई का विकास एल्गोरिदम, कंप्यूटिंग शक्ति और डेटा के समर्थन से अविभाज्य है। हालाँकि एआई द्वारा उत्पन्न पाठ और वास्तविक मानव भाषा के बीच अभी भी एक अंतर है, यह व्याकरण और तर्क के मामले में अधिक से अधिक सभ्य होता जा रहा है।

इस शांत पानी के नीचे, एआई क्रॉलिंग और एंटी-क्रॉलिंग के बीच एक मूक युद्ध चल रहा है।

वर्तमान सार्वजनिक राय के माहौल में, वेब पेज डेटा को क्रॉल करना दुनिया के खिलाफ एक निषेध बन गया है। कई समाचार रिपोर्ट टिप्पणी क्षेत्र नेटिज़न्स की अवमानना की आवाज़ से भरे हुए हैं, और वर्डफ़्रेक मूल रूप से विभिन्न भाषाओं में टेक्स्ट को क्रॉल करके बनाया गया है .

जब जेनरेटिव एआई लोकप्रिय नहीं था, तब वर्डफ़्रेक ने भी हनीमून अवधि बिताई थी।

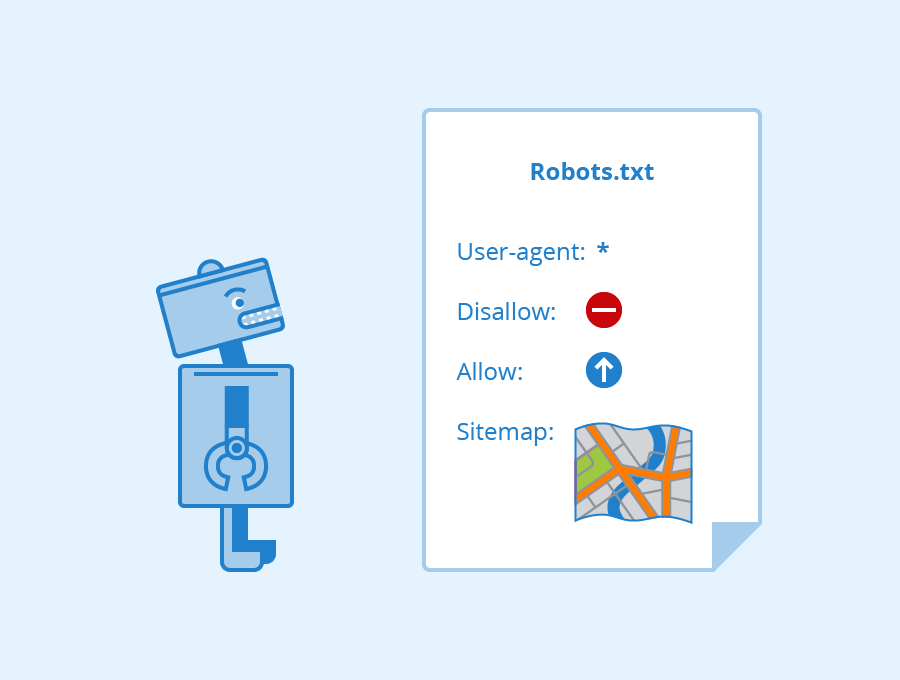

अतीत में, आम तौर पर कहें तो, जब तक वेबसाइट के robots.txt फ़ाइल नियमों का पालन किया जाता था, तब तक सार्वजनिक डेटा को क्रॉल करना उचित लगता था। यह वेबसाइट और क्रॉलर के बीच एक मौन समझौता है, जिसका उपयोग क्रॉलर को यह निर्देश देने के लिए किया जाता है कि कौन सी सामग्री क्रॉल की जा सकती है और कौन सी सामग्री नहीं।

जब कोई वेबसाइट robots.txt प्रतिबंध अनुबंध निर्धारित करती है, तो यह अतिक्रमण न करने का संकेत लगाने जैसा है। यदि क्रॉलर robots.txt समझौते का उल्लंघन करता है, या डेटा प्राप्त करने के लिए वेबसाइट की एंटी-क्रॉलर तकनीक को तोड़ने वाली विधि का उपयोग करता है, तो यह अनुचित प्रतिस्पर्धा या कॉपीराइट उल्लंघन और अन्य अवैध कार्य हो सकता है।

हालाँकि, जैसे-जैसे मॉडल की उच्च-गुणवत्ता वाले डेटा की मांग बढ़ती है, क्रॉलिंग और एंटी-क्रॉलिंग के बीच लड़ाई तेजी से भयंकर हो जाती है।

अतीत पर नज़र डालने पर, जेनरेटिव एआई विशाल क्रॉलर और एंटी-क्रॉलर डेटा पर विवाद प्रचुर मात्रा में हैं। सबसे प्रमुख स्वाभाविक रूप से OpenAI और Google हैं।

पिछले साल, OpenAI ने वेब क्रॉलर टूल GPTBot लॉन्च किया था, जिसका उपयोग AI मॉडल को प्रशिक्षित करने के लिए वेब पेज डेटा को क्रॉल करने के लिए किए जाने का दावा किया गया था। लेकिन जाहिर है, कोई भी मीडिया क्रॉलर्स द्वारा गुप्त रूप से फ़सल प्राप्त नहीं करना चाहता।

मीडिया जो डेटा और कॉपीराइट के महत्व से अवगत है, वह एक हाथ में पैसा और दूसरे हाथ में डेटा सौंपने के व्यावसायिक तर्क का पालन करता है।

रॉयटर्स इंस्टीट्यूट द्वारा किए गए एक अध्ययन से पता चलता है कि 2023 के अंत तक, दुनिया भर के 10 देशों में लगभग आधी लोकप्रिय समाचार वेबसाइटों ने ओपनएआई के क्रॉलर (क्रॉलर) को ब्लॉक कर दिया है, और लगभग एक चौथाई वेबसाइटों ने Google को भी ब्लॉक कर दिया है क्रॉलर वही कार्रवाई करता है.

हर किसी को बाद की कहानी से परिचित होना चाहिए। ओपनएआई पर हर कुछ दिनों में पारंपरिक मीडिया द्वारा मुकदमा दायर किया गया था, और बिना किसी अपवाद के यह एक कॉपीराइट मुकदमा था। इस वर्ष तक ऐसा नहीं हुआ था कि मुकदमा-ग्रस्त ओपनएआई ने समाचार प्रकाशकों के साथ साझेदारी स्थापित की थी।

हालाँकि, पिछली रणनीतियाँ जैसे ऊँची दीवारें और डेटा शुल्क ने भी वर्डफ़्रीक को इस "डेटा की कमी" का शिकार बना दिया।

स्पीयर बताते हैं कि चूंकि ट्विटर और रेडिट (वर्डफ़्रीक्यू में शामिल एक साइट) ने अपने एपीआई के लिए शुल्क लेना शुरू कर दिया है, इससे वेब को खंगालना और अधिक कठिन हो गया है।

स्पीयर ने लिखा, "जो जानकारी मुफ़्त हुआ करती थी वह महंगी हो गई है।" "मैं ऐसे किसी भी काम में शामिल नहीं होना चाहता, जिसे जेनरेटिव एआई के साथ भ्रमित किया जा सकता है या जो जेनरेटिव एआई से लाभान्वित हो सकता है।"

भले ही आप डेटा के बदले पैसे का आदान-प्रदान कर सकें, अंततः डेटा का उपयोग हो जाएगा।

रिसर्च फर्म एपोच एआई का अनुमान है कि इंटरनेट पर उपलब्ध उच्च गुणवत्ता वाला टेक्स्ट डेटा 2028 तक समाप्त हो सकता है। इस घटना को उद्योग में "डेटा वॉल" कहा जाता है और यह एआई के विकास को धीमा करने में सबसे बड़ी बाधा बन सकती है।

परिणामस्वरूप, कई बड़े मॉडल निर्माताओं ने कृत्रिम डेटा पर अपना ध्यान केंद्रित करना शुरू कर दिया, एआई को प्रशिक्षित करने के लिए एआई का उपयोग करने पर ध्यान केंद्रित किया।

एआई को प्रशिक्षित करने के लिए एआई का उपयोग करना जितना अधिक आप इसका अभ्यास करेंगे, यह इसे "बेवकूफीपूर्ण" बना सकता है।

मेरा अंतर्ज्ञान यह है कि इंटरनेट पर पाठ बकवास है, और इस डेटा पर प्रशिक्षण कंप्यूटिंग शक्ति की बर्बादी है।

जब लामा 3.1-405बी ने अपनी टेबल-टर्निंग शक्ति के साथ कई बड़े ओपन सोर्स मॉडलों में प्रवेश किया, तो लामा श्रृंखला का नेतृत्व करने वाले मेटा एआई शोधकर्ता थॉमस स्कियालोम ने एक साक्षात्कार में उपरोक्त टिप्पणी की।

उनके अनुसार, लामा 3 की प्रशिक्षण प्रक्रिया किसी मानव-लिखित उत्तर पर निर्भर नहीं है, बल्कि पूरी तरह से लामा 2 द्वारा उत्पन्न सिंथेटिक डेटा पर आधारित है।

स्कियालोम का बयान बहुत कच्चा हो सकता है, लेकिन इसमें कुछ सच्चाई है।

इंटरनेट पर हर दिन डेटा की एक स्थिर धारा उभर रही है, लेकिन एआई का प्रशिक्षण हमेशा एक बहुविकल्पीय प्रश्न रहा है यदि डेटा त्रुटियों और शोर से भरा है, तो मॉडल स्वाभाविक रूप से इन "खामियों" और भविष्यवाणी की सटीकता को सीख लेगा और वर्गीकरण की कल्पना की जा सकती है और जाना जा सकता है.

इसके अलावा, निम्न-गुणवत्ता वाला डेटा अक्सर पूर्वाग्रहों से भरा होता है और वास्तव में समग्र डेटा वितरण का प्रतिनिधित्व नहीं कर सकता है, जिससे मॉडल पक्षपाती प्रतिक्रियाएं उत्पन्न करता है। यूनेस्को महानिदेशक अज़ोले ने भी चेतावनी दी:

"नए एआई उपकरण अनजाने में लाखों लोगों की धारणाओं को बदलने की शक्ति रखते हैं, इसलिए उत्पन्न सामग्री में न्यूनतम लिंग पूर्वाग्रह भी वास्तविक दुनिया की असमानता को काफी हद तक बढ़ा सकता है।"

हालाँकि, सिंथेटिक डेटा "डेटा वॉल" समस्या को हल करने के लिए रामबाण नहीं हो सकता है।

हाल ही में, ऑक्सफोर्ड और कैम्ब्रिज के शोधकर्ताओं ने पाया कि जब कोई मॉडल एआई द्वारा उत्पन्न डेटा सेट का उपयोग करता है, तो आउटपुट की गुणवत्ता धीरे-धीरे कम हो जाएगी, अंततः अर्थहीन सामग्री उत्पन्न होगी, जिसे आमतौर पर मॉडल पतन के रूप में जाना जाता है।

अनुसंधान नेता इलिया शुमैलोव ने प्रक्रिया का वर्णन करने के लिए फोटो लेने की सादृश्यता का उपयोग किया:

यदि आप एक फोटो लेते हैं, उसे स्कैन करते हैं, उसे प्रिंट करते हैं, उसका एक फोटो लेते हैं, और फिर समय के साथ प्रक्रिया को दोहराते हैं, तो पूरी प्रक्रिया मूल रूप से "शोर" के कारण ख़त्म हो जाएगी। अंत में आपको एक काला वर्ग मिलेगा।

जब एआई द्वारा उत्पन्न अधिक से अधिक स्पैम वेब पेज इंटरनेट पर आने लगेंगे, तो एआई मॉडल के प्रशिक्षण के लिए कच्चा माल भी दूषित हो जाएगा।

उदाहरण के लिए, स्टैक ओवरफ्लो, प्रोग्रामर्स के लिए एक प्रश्नोत्तरी समुदाय, एआई से गहराई से प्रभावित हुआ है।

जब चैटजीपीटी पहली बार लोकप्रिय हुआ, तो स्टैक ओवरफ़्लो ने "अस्थायी प्रतिबंध" की घोषणा की। अधिकारी ने बयान में शिकायत की, "चैटजीपीटी से प्राप्त सही उत्तरों का औसत अनुपात बहुत कम है।"

आखिरकार, पेशेवर उपयोगकर्ताओं की संख्या सीमित है, और सभी उत्तरों को एक-एक करके सत्यापित करना असंभव है, और चैटजीपीटी की त्रुटि दर स्पष्ट है। जब AI सामुदायिक वातावरण को प्रदूषित करता है, तो जिन मनुष्यों के पास उस समय करने के लिए कुछ नहीं होता, वे केवल उस पर प्रतिबंध लगा सकते हैं।

छवियों के क्षेत्र में, एआई मॉडल सबसे आम डेटा को पुन: पेश करते हैं, और कई पुनरावृत्तियों के बाद, वे अंततः मूल चीज़ को भी भूल सकते हैं।

यह सब देखा गया एक दुष्चक्र की ओर इशारा करता है: एआई निम्न-गुणवत्ता या यहां तक कि गलत जानकारी उत्पन्न करता है, जो मानव डेटा के साथ मिश्रित होती है, ये आम तौर पर निम्न-गुणवत्ता वाले डेटा एआई द्वारा बार-बार फीड किए जाते हैं, जिससे अंततः बड़े पैमाने पर एआई खुद पर प्रतिकूल प्रभाव डालता है।

और अगर इंसानों को यह एहसास हो कि अतीत के डेटा फ़ुटप्रिंट उनके लिए पोषण बन जाएंगे, तो शायद हम इंटरनेट पर छोड़े गए हर शब्द के बारे में अधिक सतर्क होंगे।

# Aifaner के आधिकारिक WeChat सार्वजनिक खाते का अनुसरण करने के लिए आपका स्वागत है: Aifaner (WeChat ID: ifanr) आपको जल्द से जल्द अधिक रोमांचक सामग्री प्रदान की जाएगी।