बहुत अधिक आश्चर्य के बिना, मेटा लामा 3 श्रृंखला के मॉडलों के साथ "सड़कों को उड़ाने" के लिए आया, जिन्हें "इतिहास में सबसे शक्तिशाली ओपन सोर्स बड़े मॉडल" के रूप में जाना जाता है।

विशेष रूप से, मेटा ने विभिन्न आकारों, 8बी और 70बी के दो मॉडल खोले हैं।

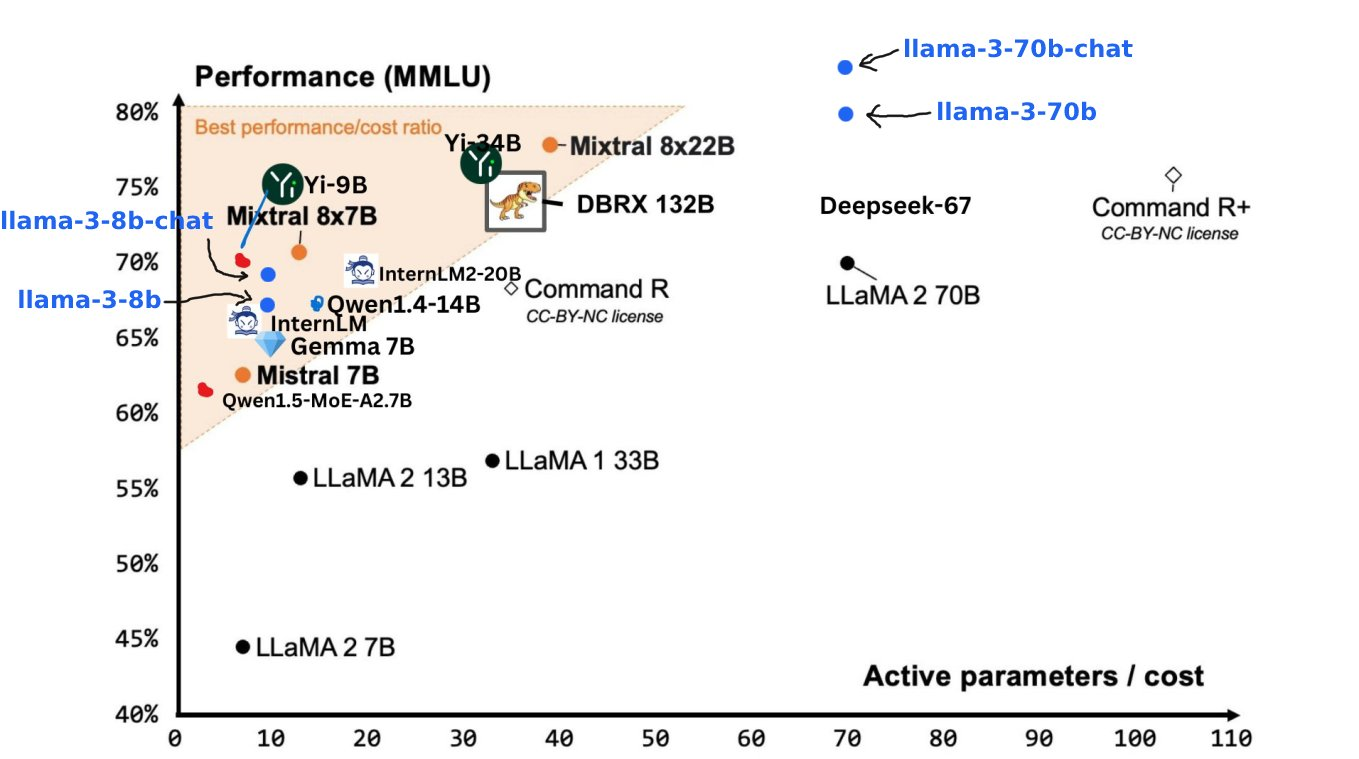

- लामा 3 8बी: मूलतः सबसे बड़े लामा 2 70बी जितना शक्तिशाली।

- लामा 3 70बी: प्रथम स्तर का एआई मॉडल, जेमिनी 1.5 प्रो के बराबर, सभी पहलुओं में क्लाउड बिग कप से आगे

उपरोक्त केवल मेटा के ऐपेटाइज़र हैं, असली भोजन अभी आना बाकी है। अगले कुछ महीनों में, मेटा क्रमिक रूप से मल्टी-मोडल, मल्टी-लैंग्वेज डायलॉग, लंबी संदर्भ विंडो और अन्य क्षमताओं के साथ नए मॉडलों की एक श्रृंखला लॉन्च करेगा, जिनमें से 400B से अधिक वाले हेवीवेट खिलाड़ी क्लाउड 3 सुपर कप के साथ प्रतिस्पर्धा करने की उम्मीद है .

लामा 3 अनुभव पता: https://llama.meta.com/llama3/

एक और जीपीटी-4 स्तर का मॉडल यहां है, लामा 3 खुला है

पिछली पीढ़ी के लामा 2 मॉडल की तुलना में, लामा 3 को एक नए स्तर पर पहुँच गया कहा जा सकता है।

प्री-ट्रेनिंग और पोस्ट-ट्रेनिंग में सुधार के लिए धन्यवाद, इस बार जारी किए गए प्री-ट्रेनिंग और इंस्ट्रक्शन फाइन-ट्यूनिंग मॉडल आज 8बी और 70बी पैरामीटर स्केल में सबसे शक्तिशाली मॉडल हैं, साथ ही, पोस्ट का अनुकूलन भी -प्रशिक्षण प्रक्रिया ने मॉडल की त्रुटि दर को काफी कम कर दिया है, मॉडल की स्थिरता को बढ़ाया है और प्रतिक्रियाओं की विविधता को समृद्ध किया है।

जुकरबर्ग ने एक बार एक सार्वजनिक भाषण में खुलासा किया था कि यह देखते हुए कि उपयोगकर्ता व्हाट्सएप में मेटा एआई कोडिंग से संबंधित प्रश्न नहीं पूछेंगे, इस क्षेत्र में लामा 2 का अनुकूलन उत्कृष्ट नहीं है।

इस बार, लामा 3 ने तर्क, कोड निर्माण और निर्देशों का पालन करने में महत्वपूर्ण सुधार हासिल किए हैं, जिससे यह अधिक लचीला और उपयोग में आसान हो गया है।

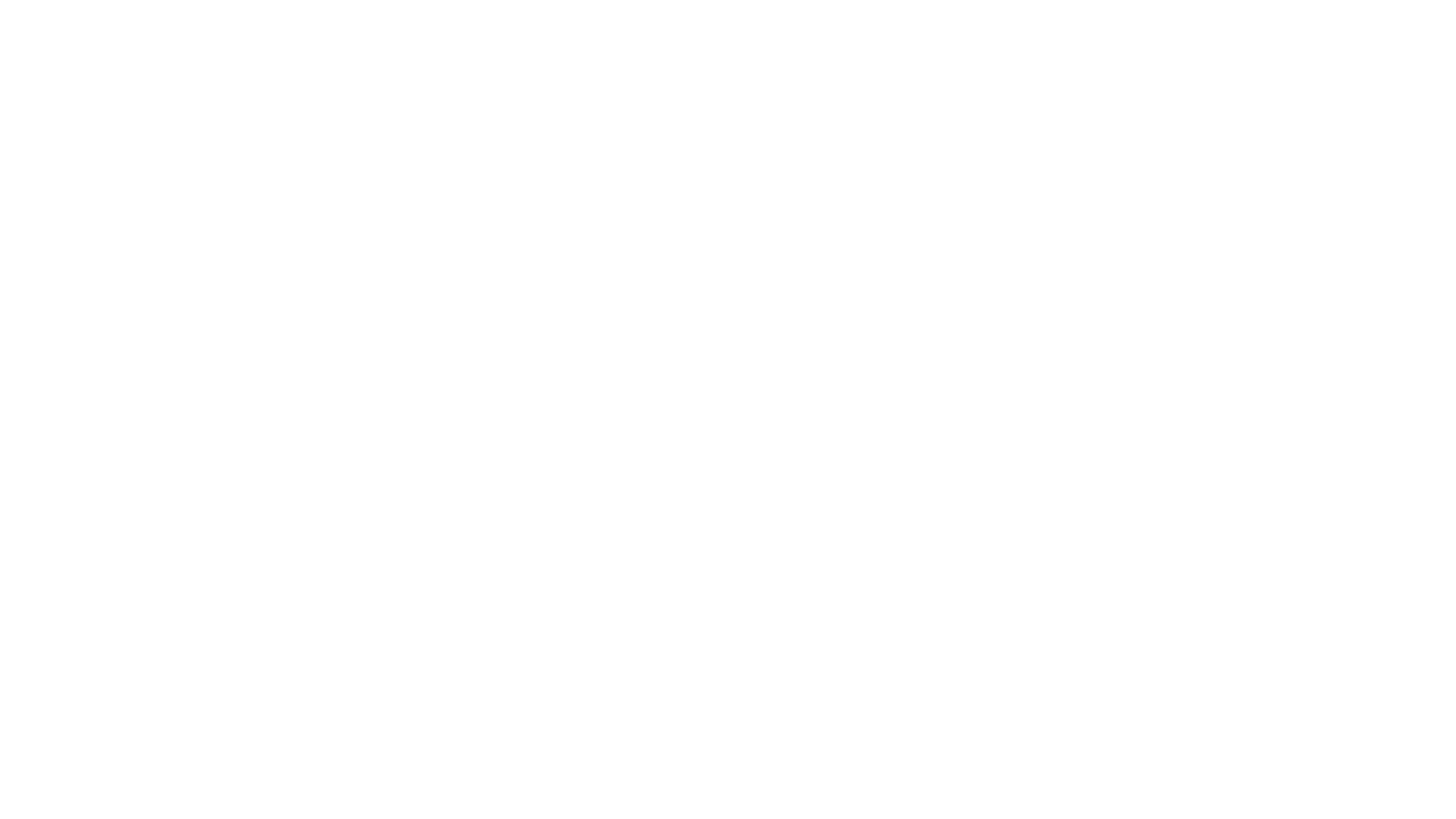

बेंचमार्क परीक्षण के नतीजे बताते हैं कि एमएमएलयू, जीपीक्यूए, ह्यूमनएवल और अन्य परीक्षणों में लामा 3 8बी का स्कोर गूगल जेम्मा 7बी और मिस्ट्रल 7बी इंस्ट्रक्ट से कहीं अधिक है। जुकरबर्ग के शब्दों में, सबसे छोटा लामा 3 मूल रूप से सबसे बड़े लामा 2 जितना ही शक्तिशाली है।

लामा 3 70बी शीर्ष एआई मॉडल में शुमार है। इसका समग्र प्रदर्शन क्लाउड 3 की तुलना में बेहतर है। जेमिनी 1.5 प्रो की तुलना में, वे समान रूप से मेल खाते हैं।

बेंचमार्क के तहत मॉडल प्रदर्शन का सटीक अध्ययन करने के लिए, मेटा ने एक नया उच्च गुणवत्ता वाला मानव मूल्यांकन डेटासेट भी विकसित किया है।

मूल्यांकन सेट में 12 प्रमुख उपयोग के मामलों को कवर करने वाले 1800 संकेत शामिल हैं: सलाह मांगना, विचार-मंथन, वर्गीकरण, बंद प्रश्नोत्तर, कोडिंग, रचनात्मक लेखन, निष्कर्षण, व्यक्तित्व, खुला प्रश्नोत्तर, तर्क, पुनर्लेखन और सारांश।

लामा 3 को इस मूल्यांकन सेट पर ओवरफिटिंग से रोकने के लिए, मेटा ने अपनी शोध टीम को इस डेटासेट तक पहुंचने से भी प्रतिबंधित कर दिया। क्लाउड सॉनेट, मिस्ट्रल मीडियम और जीपीटी-3.5 के साथ आमने-सामने की प्रतियोगिता में, मेटा लामा 70बी ने प्रतियोगिता को "जबरदस्त जीत" के साथ समाप्त किया।

मेटा आधिकारिक परिचय के अनुसार, लामा 3 ने अपने मॉडल आर्किटेक्चर में अपेक्षाकृत मानक शुद्ध डिकोडर ट्रांसफार्मर आर्किटेक्चर को चुना। लामा 2 की तुलना में, लामा 3 में कई प्रमुख सुधार हैं:

- लामा 3 भाषा को अधिक कुशलता से एनकोड करने के लिए 128K टोकन शब्दावली के साथ एक टोकननाइज़र का उपयोग करता है, जिससे मॉडल के प्रदर्शन में काफी सुधार होता है।

- लामा 3 मॉडल की अनुमान दक्षता में सुधार के लिए समूहीकृत क्वेरी ध्यान (जीक्यूए) का उपयोग 8बी और 70बी दोनों मॉडलों में किया जाता है।

- मॉडल को 8192 टोकन के अनुक्रमों पर प्रशिक्षित किया गया है, यह सुनिश्चित करने के लिए मास्क का उपयोग किया जाता है कि आत्म-ध्यान दस्तावेज़ सीमाओं को पार नहीं करता है।

प्रशिक्षण डेटा की मात्रा और गुणवत्ता अगले चरण में बड़ी मॉडल क्षमताओं के उद्भव को बढ़ावा देने में महत्वपूर्ण कारक हैं।

शुरुआत से ही, मेटा लामा 3 को संभवतः सबसे शक्तिशाली मॉडल के रूप में डिज़ाइन किया गया था। मेटा प्री-ट्रेनिंग डेटा में भारी निवेश करता है। यह बताया गया है कि लामा 3 सार्वजनिक स्रोतों से एकत्र किए गए 15T से अधिक टोकन का उपयोग करता है, जो कि लामा 2 द्वारा उपयोग किए गए डेटा सेट का सात गुना है, और इसमें मौजूद कोड डेटा लामा 2 के चार गुना है।

बहु-भाषा के व्यावहारिक अनुप्रयोग को ध्यान में रखते हुए, लामा 3 पूर्व-प्रशिक्षण डेटा सेट के 5% से अधिक में 30 से अधिक भाषाओं को कवर करने वाला उच्च गुणवत्ता वाला गैर-अंग्रेजी डेटा शामिल है, हालांकि, मेटा अधिकारियों ने यह भी स्वीकार किया कि अंग्रेजी की तुलना में, प्रदर्शन इन भाषाओं में से थोड़ी हीन होने की उम्मीद है।

यह सुनिश्चित करने के लिए कि लामा 3 को उच्चतम गुणवत्ता वाले डेटा पर प्रशिक्षित किया गया है, मेटा अनुसंधान टीम डेटा गुणवत्ता की भविष्यवाणी करने के लिए पहले से अनुमानी फिल्टर, एनएसएफडब्ल्यू फिल्टर, सिमेंटिक डिडुप्लीकेशन विधियों और टेक्स्ट क्लासिफायर का भी उपयोग करती है।

यह ध्यान देने योग्य है कि अनुसंधान टीम ने यह भी पाया कि लामा मॉडल की पिछली पीढ़ियाँ उच्च-गुणवत्ता वाले डेटा की पहचान करने में आश्चर्यजनक रूप से अच्छी थीं, इसलिए उन्होंने लामा 2 को लामा 3 द्वारा समर्थित पाठ गुणवत्ता वर्गीकरण के लिए प्रशिक्षण डेटा उत्पन्न करने दिया, जो वास्तव में "एआई प्रशिक्षण एआई" को साकार करता है। " .

प्रशिक्षण की गुणवत्ता के अलावा, लामा 3 ने प्रशिक्षण दक्षता में भी लंबी छलांग लगाई है।

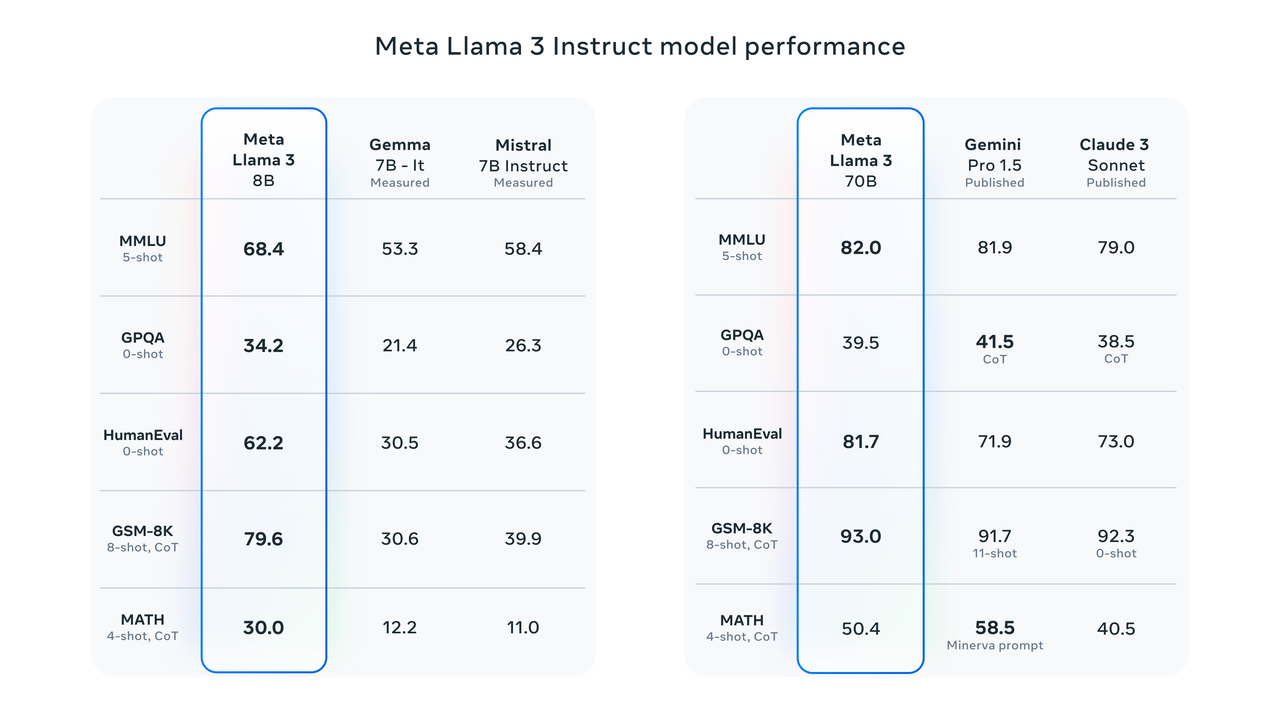

मेटा ने खुलासा किया कि सबसे बड़े लामा 3 मॉडल को प्रशिक्षित करने के लिए, उन्होंने तीन प्रकार के समानांतरीकरण को जोड़ा: डेटा समानांतरीकरण, मॉडल समानांतरीकरण और पाइपलाइन समानांतरकरण।

जब 16K GPU पर एक साथ प्रशिक्षण किया जाता है, तो प्रति GPU 400 से अधिक TFLOPS गणना उपयोग प्राप्त किया जा सकता है। अनुसंधान टीम ने दो कस्टम-निर्मित 24K जीपीयू क्लस्टर पर प्रशिक्षण रन का प्रदर्शन किया।

GPU अपटाइम को अधिकतम करने के लिए, अनुसंधान टीम ने एक उन्नत नया प्रशिक्षण स्टैक विकसित किया जो त्रुटि का पता लगाने, प्रबंधन और रखरखाव को स्वचालित करता है। इसके अलावा, मेटा ने हार्डवेयर विश्वसनीयता और मूक डेटा भ्रष्टाचार का पता लगाने वाले तंत्र में काफी सुधार किया है, और चौकियों और रोलबैक के ओवरहेड को कम करने के लिए एक नई स्केलेबल स्टोरेज प्रणाली विकसित की है।

ये सुधार कुल मिलाकर प्रभावी प्रशिक्षण समय को 95% से अधिक बनाते हैं, और लामा 3 की प्रशिक्षण दक्षता को पिछली पीढ़ी की तुलना में लगभग तीन गुना अधिक बनाते हैं।

अधिक तकनीकी विवरण के लिए, कृपया मेटा का आधिकारिक ब्लॉग देखें: https://ai.meta.com/blog/meta-llama-3/

ओपन सोर्स बनाम क्लोज्ड सोर्स

मेटा के "बेटे" के रूप में, लामा 3 स्वाभाविक रूप से एआई चैटबॉट मेटा एआई में एकीकृत है।

पिछले साल के मेटा कनेक्ट 2023 सम्मेलन की याद दिलाते हुए, ज़करबर्ग ने आधिकारिक तौर पर बैठक में मेटा एआई के लॉन्च की घोषणा की, और फिर तुरंत इसे संयुक्त राज्य अमेरिका, ऑस्ट्रेलिया, कनाडा, सिंगापुर, दक्षिण अफ्रीका और अन्य क्षेत्रों में प्रचारित किया।

पिछले साक्षात्कारों में, जुकरबर्ग लामा 3 से सुसज्जित मेटा एआई के बारे में और भी अधिक आश्वस्त थे, उन्होंने कहा था कि यह सबसे बुद्धिमान एआई सहायक होगा जिसे लोग मुफ्त में उपयोग कर सकते हैं।

मुझे लगता है कि यह एक चैटबॉट-जैसे प्रारूप से आगे बढ़ जाएगा जहां आप केवल एक प्रश्न पूछ सकते हैं और यह आपको उत्तर देगा, और आप इसे अधिक जटिल कार्य दे सकते हैं और यह उन कार्यों को पूरा करेगा।

मेटा एआई वेब अनुभव पता संलग्न है: https://www.meta.ai/

बेशक, यदि मेटा एआई "अभी तक आपके देश/क्षेत्र में उपलब्ध नहीं है", तो आप ओपन सोर्स मॉडल का उपयोग करने के लिए सबसे सरल चैनल – हगिंग फेस, दुनिया की सबसे बड़ी एआई ओपन सोर्स सामुदायिक वेबसाइट का उपयोग कर सकते हैं।

अनुभव का पता संलग्न है: https://huggingface.co/meta-llama/Meta-Llama-3-70B-Instruct

पर्प्लेक्सिटी, पो और अन्य प्लेटफार्मों ने भी तुरंत प्लेटफार्म सेवाओं में लामा 3 के एकीकरण की घोषणा की।

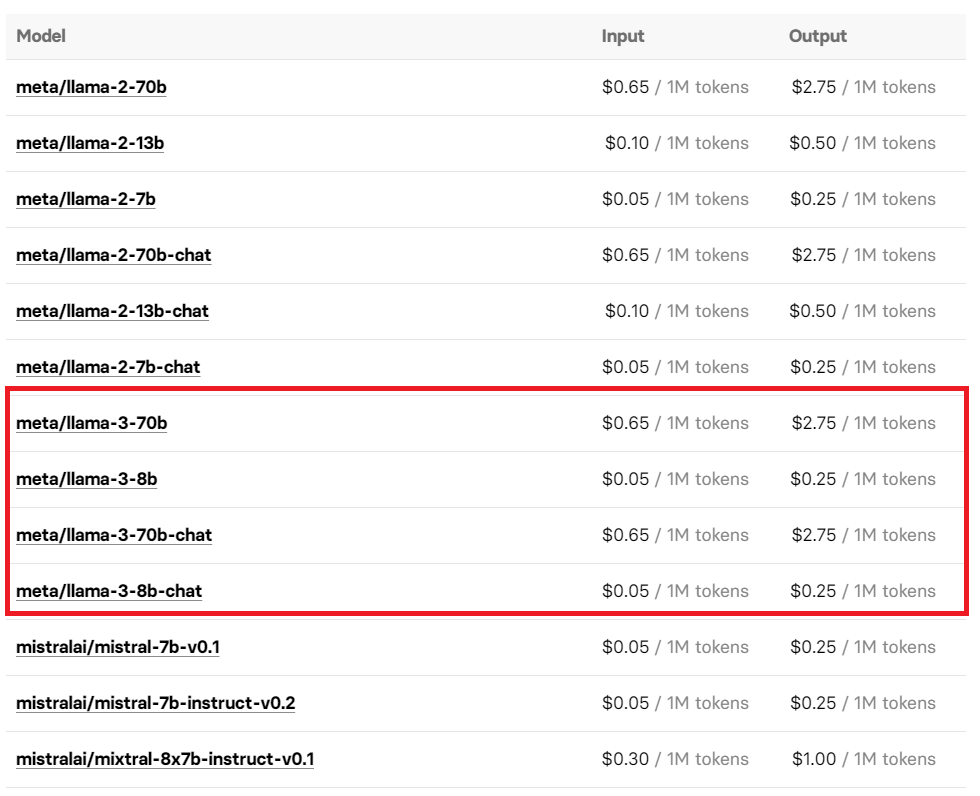

आप ओपन सोर्स मॉडल प्लेटफ़ॉर्म के रेप्लिकेट एपीआई इंटरफ़ेस को कॉल करके भी लामा 3 का अनुभव कर सकते हैं। इसके उपयोग की कीमत भी सामने आ गई है, इसलिए आप इसे मांग पर उपयोग करना चाह सकते हैं।

दिलचस्प बात यह है कि इससे पहले कि मेटा ने आधिकारिक तौर पर लामा 3 की घोषणा की, तेज-तर्रार नेटिज़न्स ने पाया कि माइक्रोसॉफ्ट के एज़्योर बाजार ने लामा 3 8बी इंस्ट्रक्ट संस्करण को चुरा लिया था, हालांकि, जैसे-जैसे यह खबर फैलती गई, जब नेटिज़न्स फिर से लिंक तक पहुंचने की कोशिश करने लगे, तो मुझे बस इतना ही पता चला "404" पृष्ठ.

वर्तमान में बहाल: https://azuremarketplace.microsoft.com/en-us/marketplace/apps/metagenai.meta-llama-3-8b-chat-offer?tab=overview

लामा 3 का आगमन सोशल प्लेटफॉर्म एक्स पर चर्चा का एक नया तूफान खड़ा कर रहा है।

मेटा एआई के मुख्य वैज्ञानिक और ट्यूरिंग पुरस्कार विजेता यान लेकन ने न केवल लामा 3 की रिलीज के लिए खुशी जताई, बल्कि एक बार फिर भविष्यवाणी की कि अगले कुछ महीनों में और संस्करण लॉन्च किए जाएंगे। यहां तक कि मस्क भी टिप्पणी क्षेत्र में उपस्थित हुए और लामा 3 के लिए अपनी मान्यता और अपेक्षाओं को संक्षिप्त और अंतर्निहित "बुरा नहीं" के साथ व्यक्त किया।

NVIDIA के एक वरिष्ठ वैज्ञानिक जिम फैन ने अपना ध्यान आगामी लामा 3 400B+ पर केंद्रित किया है, उनके विचार में, लामा 3 का लॉन्च तकनीकी प्रगति से अलग हो गया है और ओपन सोर्स मॉडल और शीर्ष बंद सोर्स मॉडल का प्रतीक है। .

साझा किए गए बेंचमार्क परीक्षण से यह देखा जा सकता है कि लामा 3 400बी+ की ताकत लगभग क्लाउड एक्स्ट्रा लार्ज कप और जीपीटी-4 टर्बो के नए संस्करण के बराबर है, हालांकि अभी भी एक निश्चित अंतर है, यह साबित करने के लिए पर्याप्त है कि इसका स्थान शीर्ष बड़े मॉडलों में है।

आज स्टैनफोर्ड यूनिवर्सिटी के प्रोफेसर और एआई के शीर्ष विशेषज्ञ एंड्रयू एनजी का जन्मदिन है। लामा 3 का आगमन निस्संदेह उनके जन्मदिन का जश्न मनाने का सबसे खास तरीका है।

यह कहना होगा कि आज का ओपन सोर्स मॉडल वास्तव में सौ फूलों को खिलने और सौ विचारधाराओं को प्रतिस्पर्धा करने दे रहा है।

इस साल की शुरुआत में, जुकरबर्ग, जिनके पास 350,000 जीपीयू हैं, ने द वर्ज के साथ एक साक्षात्कार में दृढ़ स्वर में मेटा के दृष्टिकोण का वर्णन किया – एजीआई (कृत्रिम सामान्य बुद्धि) के निर्माण के लिए प्रतिबद्ध।

ओपनएआई के बिल्कुल विपरीत, जो खुला नहीं है, मेटा ने ओपन सोर्स मार्ग के साथ एजीआई के पवित्र ग्रेल की ओर एक शुल्क शुरू किया है।

जैसा कि जुकरबर्ग ने कहा, मेटा, जो दृढ़ता से खुला स्रोत है, ने इस चुनौतीपूर्ण यात्रा पर कुछ भी हासिल नहीं किया है:

मैं आम तौर पर यह सोचने में इच्छुक हूं कि खुला स्रोत समुदाय के लिए अच्छा है और हमारे लिए अच्छा है क्योंकि हम नवाचार से लाभान्वित होते हैं।

पिछले वर्ष में, पूरा एआई सर्कल ओपन सोर्स या क्लोज्ड सोर्स रूट के आसपास अंतहीन बहस कर रहा है। यह बहस तकनीकी स्तर पर फायदे और नुकसान की तुलना से आगे बढ़ गई है और एआई के भविष्य के विकास की मूल दिशा को छू गई है। यहां तक कि मस्क, जो व्यक्तिगत रूप से बाहर गए थे, ने ओपन सोर्स ग्रोक 1.0 द्वारा दुनिया में बदलाव लाया।

कुछ समय पहले, कुछ राय में कहा गया था कि ओपन सोर्स मॉडल तेजी से पिछड़ा हो जाएगा। अब लामा 3 के आगमन ने भी इस निराशावादी दृष्टिकोण को एक जोरदार तमाचा मारा है।

हालाँकि, हालांकि लामा 3 ओपन सोर्स मॉडल में कुछ राहत लाता है, ओपन सोर्स बनाम क्लोज्ड सोर्स के बारे में यह बहस अभी खत्म नहीं हुई है।

आख़िरकार, GPT-4.5/5, जो गुप्त रूप से लॉन्च करने की तैयारी कर रहा है, इस गर्मी में बेजोड़ प्रदर्शन के साथ इस लंबी बहस को समाप्त कर सकता है।

# Aifaner के आधिकारिक WeChat सार्वजनिक खाते का अनुसरण करने के लिए आपका स्वागत है: Aifaner (WeChat ID: ifanr) आपको जल्द से जल्द अधिक रोमांचक सामग्री प्रदान की जाएगी।