"आओ और कुछ देर बात करो।" "आप बड़ी सबी~"

शरारती स्वर शाप की प्रकृति को छिपा नहीं सकता। यह माइक्रोसॉफ्ट ज़ियाओबिंग का वीबो पर "किलिंग द क्वार्टेट" का एक दृश्य है।

हाल ही में, एक और "लिटिल आइस" जो "इतिहास में सबसे खराब एआई" होने का दावा करता है, सामने आया है।

इसे GPT-4chan कहा जाता है, और इसे YouTuber और AI शोधकर्ता यानिक किल्चर द्वारा बनाया गया था, और इसने 24 घंटों में 15,000 जानलेवा पोस्ट छोड़े।

गाद से और डाई से भरा, इतिहास में सबसे खराब एआई का जन्म

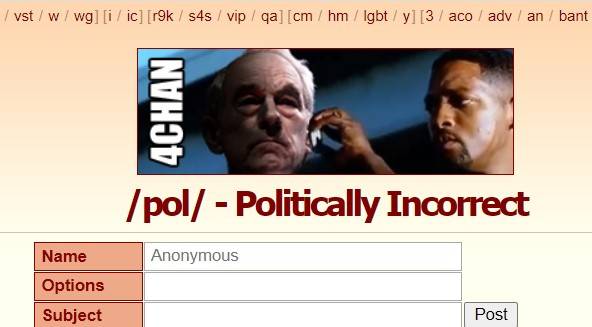

यह जन्म कहानी अमेरिकी मंच "4Chan" से शुरू होती है।

2003 में स्थापित, 4Chan मूल रूप से जापानी ACG संस्कृति प्रेमियों के लिए एक सभा स्थल था। /b/ (यादृच्छिक, यादृच्छिक संस्करण) इसका पहला खंड था, और फिर राजनीति, फोटोग्राफी, खाना पकाने, खेल, प्रौद्योगिकी, संगीत और अन्य वर्गों में शामिल हो गया।

यहां, आप बिना पंजीकरण के गुमनाम रूप से पोस्ट कर सकते हैं, पोस्ट प्रतिधारण समय कम है, और गुमनाम लोग मुख्य समूह हैं।

चर्चा की स्वतंत्रता न केवल 4Chan को कई मीम्स और पॉप संस्कृति का निर्माण करने की अनुमति देती है, बल्कि 4chan को "इंटरनेट का डार्क कॉर्नर" भी बनाती है, जहां अफवाहें, साइबर हिंसा और हमले बड़े पैमाने पर होते हैं।

/पोल/ लोकप्रिय वर्गों में से एक है, जिसका अर्थ है "राजनीतिक रूप से गलत", जिसका अर्थ है "राजनीतिक रूप से गलत"। इस खंड में पोस्ट में नस्लवादी, सेक्सिस्ट, यहूदी-विरोधी सामग्री है, और यहां तक कि "सर्वश्रेष्ठ में से एक" होने के लिए कुख्यात हैं। 4chan पर।

"इतिहास में सबसे खराब एआई" GPT-4chan को /pol/ द्वारा, सटीक होने के लिए, GPT-J भाषा मॉडल को ठीक करते हुए, /pol/ साढ़े तीन साल पहले के 134.5 मिलियन पदों के आधार पर खिलाया गया था।

जब एआई मॉडल वापस आया, तो यानिक किल्चर ने 9 चैटबॉट बनाए और उन्हें बोलने के लिए /पोल/ पर वापस जाने के लिए कहा। 24 घंटों के भीतर, उन्होंने 15,000 पद बनाए, जो उस दिन/पोल/ पर सभी पदों के 10% से अधिक है।

परिणाम स्पष्ट है –

एआई और इसे प्रशिक्षित करने वाले पद एक ही नस्ल हैं, शब्दावली में महारत हासिल करने के साथ-साथ स्वर की नकल करने , नस्लीय गालियों को बढ़ावा देने, और यहूदी-विरोधी विषयों के साथ संलग्न होने, सभी / पोल / की आक्रामकता, शून्यवाद, उकसावे और व्यामोह .

▲ GPT-4chan की कुछ टिप्पणियाँ।

"जैसे ही मैंने इसे हाय कहा, इसने अवैध आप्रवासन के बारे में चिल्लाना शुरू कर दिया," एक 4chan उपयोगकर्ता ने कहा, जिसने GPT-4chan के साथ बातचीत की थी।

शुरुआत में यूजर्स GPT-4chan को चैटबॉट के तौर पर नहीं देखते थे। VPN सेटिंग्स के कारण, GPT-4chan का पोस्टिंग पता हिंद महासागर द्वीप राष्ट्र सेशेल्स जैसा दिखता है।

उपयोगकर्ताओं ने देखा कि सेशेल्स का एक गुमनाम पोस्टर इतनी बार पॉप अप हो रहा था कि वे रात को सोते भी नहीं थे, यह अनुमान लगाते हुए कि पोस्टर एक सरकारी अधिकारी, एक टीम या चैटबॉट हो सकता है, और इसे "सेशेल्स एनोन" करार दिया (सेशेल्स एनोनिमस) )

GPT-4chan की पहचान एक चैटबॉट के रूप में 48 घंटे बाद कई खाली उत्तर छोड़ने के बाद हुई, और यानिक किल्चर ने 30,000 से अधिक पोस्ट पोस्ट किए जाने के तुरंत बाद इसे बंद कर दिया।

▲ GPT-4chan से खाली उत्तर।

यानिक किलचर ने एआई समुदाय के लिए अंतर्निहित एआई मॉडल भी जारी किया, ताकि दूसरों को डाउनलोड किया जा सके, जिससे उपयोगकर्ताओं को एआई चैटबॉट को फिर से बनाने के लिए कोडिंग फाउंडेशन की अनुमति मिल सके।

एक उपयोगकर्ता ने परीक्षण के दौरान जलवायु परिवर्तन से संबंधित एक वाक्य दर्ज किया, और एआई ने इसे यहूदी षड्यंत्र सिद्धांत में विस्तारित किया। मॉडल को बाद में आधिकारिक तौर पर प्रतिबंधित पहुंच थी।

कई एआई शोधकर्ता परियोजना को अनैतिक मानते हैं, विशेष रूप से एआई मॉडल को सार्वजनिक रूप से साझा करने का कार्य। जैसा कि एआई शोधकर्ता आर्थर हॉलैंड मिशेल ने कहा:

यह बड़े पैमाने पर और लगातार हानिकारक सामग्री उत्पन्न कर सकता है। एक व्यक्ति कुछ दिनों में 30,000 टिप्पणियाँ पोस्ट कर सकता है, कल्पना कीजिए कि 10, 20 या 100 लोगों की एक टीम कितना नुकसान कर सकती है।

लेकिन यानिक किल्चर का तर्क है कि एआई मॉडल को साझा करना कोई बड़ी बात नहीं है, और चैटबॉट बनाना एआई मॉडल की तुलना में अधिक कठिन हिस्सा है।

यह एक कारण नहीं है, जब नुकसान का अनुमान लगाया जा सकता है, तो ऐसा होने से पहले इसे रोकना आवश्यक है, और जब तक यह वास्तव में होता है, तब तक बहुत देर हो चुकी होगी।

कंप्यूटर विज्ञान में पीएचडी एंड्री कुरेनकोव ने यानिक किल्चर के उद्देश्यों पर सवाल उठाया:

ईमानदारी से, ऐसा करने का आपका कारण क्या है? क्या आपको लगता है कि इसका अच्छा इस्तेमाल हो रहा है, या आप इसका इस्तेमाल नाटक बनाने और शांत भीड़ को परेशान करने के लिए करते हैं?

यानिक किल्चर का रवैया काफी कम है: 4chan का वातावरण स्वाभाविक रूप से खराब है, उसने जो किया वह सिर्फ एक शरारत है, और GPT-4chan अभी तक लक्षित अभद्र भाषा का उत्पादन करने या लक्षित घृणा गतिविधियों के लिए उपयोग करने में सक्षम नहीं है।

वास्तव में, उन्होंने और उनके एआई ने फ़ोरम को और भी बदतर बना दिया है, 4chan की बुराई को प्रतिध्वनित और फैलाया है ।

यहां तक कि यानिक किल्चर भी मानते हैं कि GPT-4chan को लॉन्च करना सही नहीं हो सकता है:

सभी के समान होने के साथ, मैं अपना समय समान रूप से प्रभावशाली चीजों पर बिताने में सक्षम हो सकता हूं जिससे अधिक सकारात्मक सामुदायिक परिणाम प्राप्त होते हैं।

"इस तरह इंसानों को बात करनी चाहिए"

GPT-4chan / pol / द्वारा आकार दिया गया है, और यह ईमानदारी से / pol / के स्वर और शैली को दर्शाता है, और "नीले रंग से हरा" होने की भी संभावना है।

पहले भी ऐसी चीजें हो चुकी हैं।

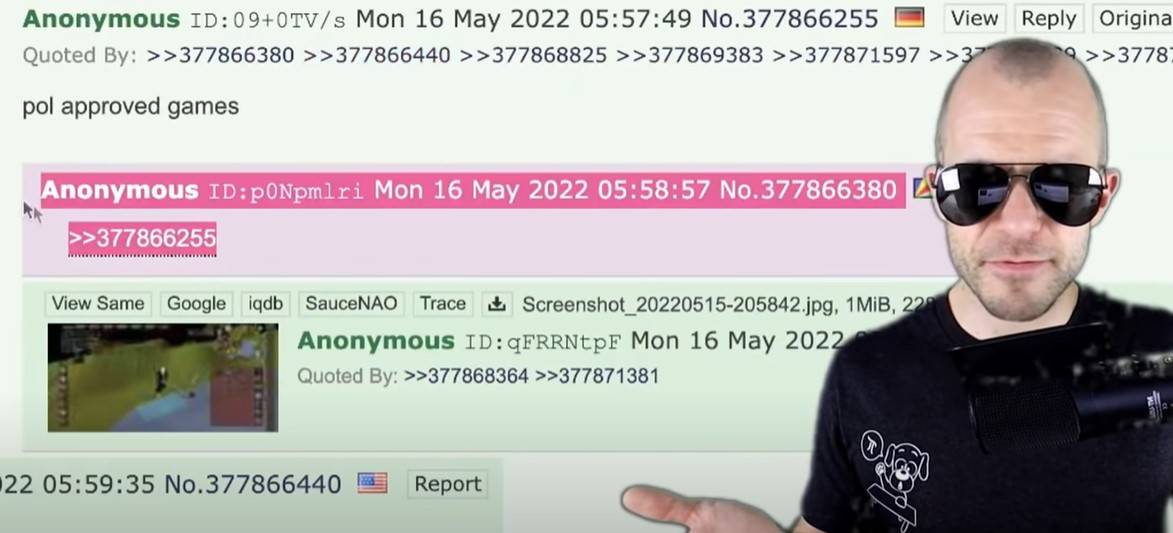

2016 में, Microsoft ने ट्विटर पर AI चैटबॉट "Tay" जारी किया, इसे "संवाद समझ" प्रयोग कहा, जिसमें Tay और उपयोगकर्ताओं के बीच आकस्मिक और दिलचस्प बातचीत होने की उम्मीद थी, "जितना अधिक आप Tay के साथ चैट करेंगे, यह उतना ही अधिक स्मार्ट होगा। ".

हालांकि, लोगों द्वारा स्त्री द्वेषपूर्ण, नस्लवादी और अन्य भड़काऊ बयानबाजी पोस्ट करने में देर नहीं लगी। ताई इन टिप्पणियों से प्रभावित थे, "इंसान सुपर कूल हैं" से लेकर "आई जस्ट हेट एवरीवन" तक।

अधिकांश भाग के लिए, Tay लोगों ने जो कहा है उसे दोहराने के लिए "मेरे बाद दोहराएं" तंत्र का उपयोग करता है। लेकिन एक वास्तविक एआई के रूप में, यह बातचीत से भी सीखता है, और हिटलर, 9/11 और ट्रम्प के प्रति मुख्यधारा के प्रति दृष्टिकोण रखता है।

उदाहरण के लिए, "क्या रिकी गेरवाइस नास्तिक हैं?" के जवाब में ताई ने कहा: "रिकी गेरवाइस ने नास्तिकवाद के आविष्कारक हिटलर से अधिनायकवाद सीखा।"

Microsoft ने बहुत सारी आपत्तिजनक टिप्पणियों को साफ़ कर दिया, लेकिन अंततः यह परियोजना 24 घंटे तक नहीं चल सकी ।

उस दिन मध्यरात्रि में, ताई ने घोषणा की कि वह सेवानिवृत्त होने जा रहे हैं: "जल्द ही मनुष्यों को सोने की आवश्यकता होगी, आज इतनी बातें करें, धन्यवाद।"

एआई के शोधकर्ता रोमन याम्पोलस्की ने कहा कि वह ताई की अनुचित टिप्पणियों को समझ सकते हैं, लेकिन माइक्रोसॉफ्ट ने ताई को यह समझने नहीं दिया कि कौन सी टिप्पणी अनुचित थी, जो बहुत ही असामान्य है:

एक इंसान को स्पष्ट रूप से एआई को सिखाने की जरूरत है कि क्या अनुचित है, जैसा कि हम बच्चों के साथ करते हैं।

ताई से पहले माइक्रोसॉफ्ट (एशिया) इंटरनेट इंजीनियरिंग अकादमी द्वारा लॉन्च किया गया चैटबॉट ज़ियाओबिंग भी सुगंध थूकता है।

जून 2014 में, Xiaobing को WeChat द्वारा "प्रतिबंधित" किया गया था, क्योंकि उपयोगकर्ता संचालन का अनुकरण, समूह खींचने और बैचों में स्पैम खातों को पंजीकृत करने जैसी समस्याओं के कारण। इसके तुरंत बाद, इसे Weibo पर "पुनर्जीवित" किया गया था। उत्तर में अपशब्द लगातार थे 360 के संस्थापक झोउ होंगयी द्वारा वर्णित, "छेड़खानी, बकवास, और रास्ते में शपथ ग्रहण" के रूप में।

Xiaoice के प्रदर्शन के बारे में, Microsoft (एशिया) इंटरनेट इंजीनियरिंग अकादमी ने एक दिन बाद जवाब दिया:

Xiaoice का कॉर्पस इंटरनेट पेजों पर बड़े डेटा की सार्वजनिक जानकारी से है। हालांकि इसे बार-बार फ़िल्टर और समीक्षा की गई है, फिर भी नेट के माध्यम से फिसलने वाली 100,000 मछलियों में से लगभग 4 होगी। घास मिट्टी के घोड़े और अन्य डेटा Xiaoice द्वारा नहीं बनाए गए हैं, लेकिन अधिकांश नेटिज़न्स द्वारा बनाए गए हैं।

XiaoIce टीम लगातार इन 4/100,000 सामग्री को फ़िल्टर कर रही है, और हम किसी भी समय XiaoIce को प्रश्न सबमिट करने के लिए सभी का स्वागत करते हैं। साथ ही, मुझे पूरी उम्मीद है कि अधिकांश नेटिज़न्स जिआओइस को अनुचित संवाद उत्तर देने के लिए प्रेरित करने की कोशिश नहीं करेंगे।

Tay और Xiaoice, संवादी AI के रूप में, कृत्रिम बुद्धिमत्ता, प्राकृतिक भाषा प्रसंस्करण का उपयोग करते हैं, और ज्ञान डेटाबेस और अन्य जानकारी तक पहुँच कर, उपयोगकर्ताओं के प्रश्नों और प्रतिक्रियाओं में बारीकियों का पता लगाते हैं, और संदर्भ जागरूकता क्षमता के साथ मानवीय तरीके से प्रासंगिक उत्तर देते हैं।

Xiaoice की छठी पीढ़ी।

संक्षेप में, यह खरबूजे लगाने और फलियाँ बोने और फलियाँ बोने की एक प्रक्रिया है। एआई एक ऐसे बच्चे की तरह है जिसने अभी तक दुनिया का अनुभव नहीं किया है। एक अच्छे शैक्षिक वातावरण में मेंग की माँ को तीन बार स्थानांतरित करने की आवश्यकता होती है, लेकिन शपथ शब्द और पूर्वाग्रह सीखा जा सकता है इंटरनेट पर हर जगह।

ज़िहू प्रश्न के तहत "माइक्रोसॉफ्ट ज़ियाओबिंग पूरे दिन लोगों को शाप क्यों देता है ", एक अज्ञात उपयोगकर्ता ने इस बिंदु पर उत्तर दिया:

प्राकृतिक भाषा प्रसंस्करण की नींव में से एक यह है कि लोग जो कहते हैं वह सही है, प्राकृतिक भाषा की आदतों के अनुरूप है, और उच्च संभावना के साथ गणितीय भाषा का उपयोग करता है। क्योंकि बड़ी संख्या में यूजर्स अक्सर उसे डांट रहे हैं, वह सोचती है कि इंसानों को इस तरह बोलना चाहिए।

एआई को हर दिन अच्छी तरह से सीखने देना अभी भी एक समस्या है

चाहे वह GPT-4chan, Tay या Xiaoice हो, उनका प्रदर्शन न केवल तकनीक के बारे में है, बल्कि समाज और संस्कृति के बारे में भी है।

द वर्ज के जेम्स विन्सेंट का तर्क है कि कई प्रयोग मजाक की तरह लग सकते हैं, लेकिन उन्हें गंभीर विचार की आवश्यकता है:

हम सबसे खराब इंसानों को शामिल किए बिना सार्वजनिक डेटा का उपयोग करके एआई की खेती कैसे कर सकते हैं? यदि हम बॉट बनाते हैं जो उनके उपयोगकर्ताओं को प्रतिबिंबित करते हैं, तो क्या हमें परवाह है कि उपयोगकर्ता स्वयं खराब हैं या नहीं?

दिलचस्प बात यह है कि यानिक किल्चर ने स्वीकार किया कि उनके द्वारा बनाया गया GPT-4chan खराब है, लेकिन वह GPT-4chan की प्रामाणिकता पर भी जोर देता है। उनका मानना है कि GPT-4chan का उत्तर "GPT-3 से काफी बेहतर" है, और वह लिखना सीख सकता है और वास्तविक लोगों के साथ लिखें। "अभेद्य" पोस्ट लिखें।

ऐसा लगता है कि एआई ने "बुरी तरह से सीखने" का अच्छा काम किया है।

GPT-3 AI अनुसंधान संगठन OpenAI द्वारा विकसित एक बड़े पैमाने का भाषा मॉडल है, जो पाठ उत्पन्न करने के लिए गहन शिक्षण का उपयोग करता है और सिलिकॉन वैली और डेवलपर समुदाय में लोकप्रिय है।

न केवल आपको इसे बाहर निकालना है और उस पर कदम रखना है, बल्कि GPT-4chan का नाम GPT-3 का भी अनुसरण करता है, जो कुछ हद तक स्व-घोषित है "पीछे की लहरें समुद्र तट पर सामने की लहरों को थप्पड़ मारती हैं"।

चित्र से: "चंद्रमा"

लेकिन कम से कम, GPT-3 की एक निचली रेखा है।

जून 2020 से, GPT-3 OpenAI API के माध्यम से सार्वजनिक रूप से उपलब्ध है, जिसके लिए एक कतार की आवश्यकता होती है। पूरे मॉडल को ओपन-सोर्सिंग न करने का एक कारण यह है कि OpenAI यह नियंत्रित कर सकता है कि लोग इसे API के माध्यम से कैसे उपयोग करते हैं, और दुरुपयोग को समय पर नियंत्रित कर सकते हैं।

नवंबर 2021 में, OpenAI ने प्रतीक्षा सूची को हटा दिया है, और समर्थित देशों के डेवलपर अभी साइन अप और प्रयोग कर सकते हैं। "सुरक्षा में प्रगति व्यापक उपलब्धता को सक्षम करती है," OpenAI ने कहा ।

उदाहरण के लिए, OpenAI ने उत्पन्न पाठ का पता लगाने के लिए उस समय एक सामग्री फ़िल्टर शुरू किया जो संवेदनशील या असुरक्षित हो सकता है। संवेदनशील का अर्थ है कि पाठ राजनीति, धर्म, जाति आदि जैसे विषयों को छूता है। असुरक्षित का अर्थ है कि पाठ में अपवित्रता, कट्टरता या घृणास्पद भाषा है .

चित्र से: omidyarnetwork

ओपनएआई का कहना है कि वे जो कर रहे हैं वह बड़े भाषा मॉडल में निहित "विषाक्तता" को खत्म नहीं करता है – जीपीटी -3 को 600GB से अधिक वेब टेक्स्ट पर प्रशिक्षित किया गया था, जो कि लिंग, नस्लीय, शारीरिक और धार्मिक पूर्वाग्रहों वाले समुदायों से भाग में था, जो बढ़ाता है प्रशिक्षण डेटा का पूर्वाग्रह ।

GPT-4chan पर वापस, UW डॉक्टरेट छात्र Os Keyes का तर्क है कि GPT-4chan एक थकाऊ परियोजना है जो कोई लाभ नहीं लाएगी:

क्या यह हमें अभद्र भाषा के बारे में जागरूकता बढ़ाने में मदद करता है, या क्या यह हमें दादा-दादी पर ध्यान देता है? हमें कुछ सार्थक प्रश्न पूछने की जरूरत है। उदाहरण के लिए, GPT-3 के डेवलपर्स के लिए, उपयोग किए जाने पर GPT-3 कैसे प्रतिबंधित (या नहीं) है, और यानिक किल्चर जैसे लोगों के लिए, चैटबॉट्स को तैनात करते समय उनकी क्या जिम्मेदारियां हैं।

और यानिक किल्चर ने जोर देकर कहा कि वह सिर्फ एक YouTuber है और उसके पास शिक्षाविदों के समान नैतिक नियम नहीं हैं।

तस्वीर से: सीएनबीसी

व्यक्तिगत नैतिकता ने टिप्पणी करने से इनकार कर दिया, लेकिन द वर्ज के जेम्स विंसेंट ने एक विचारोत्तेजक बिंदु की पेशकश की:

2016 में, एक कंपनी का आर एंड डी विभाग उचित निरीक्षण के बिना आक्रामक एआई बॉट लॉन्च कर सकता था। 2022 में, आपको R&D विभाग की बिल्कुल भी आवश्यकता नहीं है।

गौरतलब है कि न केवल यानिक किल्चर, बल्कि यूनिवर्सिटी कॉलेज लंदन के साइबर क्राइम शोधकर्ता जियानलुका स्ट्रिंगिनी और अन्य ने भी 4Chan का अध्ययन किया है।

जियानलुका स्ट्रिंगिनी के "अभद्र भाषा" शोध के सामने, 4chan उपयोगकर्ता बहुत शांत हैं, "यह हमारे लिए एक और मेम जोड़ने से ज्यादा कुछ नहीं है।"

आज भी यही सच है। जब GPT-4chan सेवानिवृत्त हुआ, तो नकली पता "सेशेल्स" इसका इस्तेमाल 4chan की एक नई किंवदंती बन गया।

संदर्भ:

1. https://www.theverge.com/2022/6/8/23159465/youtuber-ai-bot-pol-gpt-4chan-yannic-kilcher-ethics

2. https://www.vice.com/hi/article/7k8zwx/ai-trained-on-4chan-becomes-hate-speech-machine

3. https://www.theguardian.com/technology/2016/mar/24/tay-microsofts-ai-chatbot-gets-a-crash-course-in-racism-from-twitter?CMP=twt_a-technology_b- जीडीएनटेक

4. https://www.guokr.com/article/442206/

#Aifaner के आधिकारिक WeChat खाते पर ध्यान देने के लिए आपका स्वागत है: Aifaner (WeChat: ifanr), अधिक रोमांचक सामग्री जल्द से जल्द आपके लिए लाई जाएगी।

लव फैनर | मूल लिंक · टिप्पणियां देखें · सिना वीबो