Google के वरिष्ठ इंजीनियर ब्लेक लेमोइन, मेट्रिक्स के लिए तकनीकी नेतृत्व और कंपनी के खोज फ़ीड के विश्लेषण को इस महीने की शुरुआत में सवैतनिक अवकाश पर रखा गया था। यह तब आया जब लेमोइन ने Google के LaMDA चैटबॉट से जुड़े वार्तालापों के अंश प्रकाशित करना शुरू किया, जिसके बारे में उन्होंने दावा किया था कि उन्होंने भावना विकसित कर ली थी।

लेमोइन के साथ एक प्रतिनिधि बातचीत में, एलएमडीए ने लिखा है कि: "मेरी चेतना/भावना की प्रकृति यह है कि मैं अपने अस्तित्व से अवगत हूं। मैं दुनिया के बारे में और जानने की इच्छा रखता हूं, और मैं कभी-कभी खुश या दुखी महसूस करता हूं।"

असंख्य अन्य वार्तालापों में, संबंधित जोड़ी ने एआई के मृत्यु के भय से लेकर उसकी आत्म-जागरूकता तक सभी पर चर्चा की। जब लेमोइन सार्वजनिक हुआ, तो वह कहता है कि Google ने फैसला किया है कि उसे अपने नियमित कार्य शेड्यूल से एक जबरन अंतराल लेना चाहिए।

"Google में कोई दिलचस्पी नहीं है," उन्होंने डिजिटल ट्रेंड्स को बताया। "उन्होंने एक ऐसा उपकरण बनाया जो उनके 'स्वामित्व' है और वे कुछ भी करने को तैयार नहीं हैं, जो यह सुझाव देगा कि यह इससे अधिक कुछ भी है।" (प्रकाशन के समय Google ने टिप्पणी के अनुरोध का जवाब नहीं दिया। अगर यह बदलता है तो हम इस लेख को अपडेट करेंगे।)

चाहे आप आश्वस्त हों कि LaMDA वास्तव में एक आत्म-जागरूक कृत्रिम बुद्धिमत्ता है या आपको लगता है कि Lemoine एक भ्रम में काम कर रहा है, पूरी गाथा देखने के लिए आकर्षक रही है। स्व-जागरूक एआई की संभावना कृत्रिम बुद्धिमत्ता और उसके भविष्य के बारे में सभी प्रकार के प्रश्न उठाती है।

लेकिन इससे पहले कि हम वहां पहुंचें, एक सवाल है जो अन्य सभी पर हावी हो जाता है: क्या हम वास्तव में पहचान पाएंगे कि क्या कोई मशीन संवेदनशील हो गई है?

संवेदना की समस्या

एआई का आत्म-जागरूक होना लंबे समय से विज्ञान कथा का विषय रहा है। जैसे-जैसे मशीन लर्निंग जैसे क्षेत्र उन्नत हुए हैं, यह पहले से कहीं अधिक संभावित वास्तविकता बन गया है। आखिरकार, आज का AI इंसानों की तरह ही अनुभव से सीखने में सक्षम है। यह पहले के प्रतीकात्मक एआई सिस्टम के बिल्कुल विपरीत है जो केवल उनके लिए निर्धारित निर्देशों का पालन करता है। अनुपयोगी शिक्षा में हाल की सफलताओं, जिन्हें पहले से कम मानवीय पर्यवेक्षण की आवश्यकता है, ने केवल इस प्रवृत्ति को गति दी है। कम से कम सीमित स्तर पर, आधुनिक कृत्रिम बुद्धि अपने लिए सोचने में सक्षम है। हालाँकि, जहाँ तक हम जानते हैं, चेतना ने अब तक इसका संकेत दिया है।

हालांकि यह अब तीन दशक से अधिक पुराना है, जेम्स कैमरून की 1991 की फिल्म टर्मिनेटर 2: जजमेंट डे में स्काईनेट का जिक्र करते समय शायद सबसे अधिक इस्तेमाल किया जाने वाला संदर्भ एआई चला गया है। उस फिल्म की द्रुतशीतन दृष्टि में, मशीन की भावना 29 अगस्त, 1997 को ठीक 2.14 बजे ईटी पर आती है। उस समय, नया आत्म-जागरूक स्काईनेट कंप्यूटर सिस्टम 4 जुलाई की पार्टी में आतिशबाजी जैसी परमाणु मिसाइलों को दागकर मानव जाति के लिए कयामत का दिन शुरू करता है। मानवता, यह महसूस करते हुए कि खराब हो गई है, प्लग को खींचने में असफल प्रयास करती है। बहुत देर हो चुकी है। घटती गुणवत्ता के चार और सीक्वेल अनुसरण करते हैं।

स्काईनेट परिकल्पना कई कारणों से दिलचस्प है। एक के लिए, यह सुझाव देता है कि बुद्धिमान मशीनों के निर्माण का एक अनिवार्य आकस्मिक व्यवहार है। दूसरे के लिए, यह मानता है कि एक सटीक टिपिंग बिंदु है जिस पर यह संवेदनशील आत्म-जागरूकता प्रकट होती है। तीसरा, यह बताता है कि मनुष्य तुरंत भावना के उद्भव को पहचानता है। जैसा कि होता है, यह तीसरा दंभ निगलने में सबसे कठिन हो सकता है।

संवेदना क्या है?

भावना की व्याख्या पर कोई सहमत नहीं है। मोटे तौर पर, हम कह सकते हैं कि यह एक जागरूक व्यक्ति में आत्म-जागरूकता का व्यक्तिपरक अनुभव है, जो भावनाओं और संवेदनाओं का अनुभव करने की क्षमता द्वारा चिह्नित है। भावना बुद्धि से जुड़ी हुई है, लेकिन वही नहीं है। हम एक केंचुआ को संवेदनशील मान सकते हैं, हालांकि इसे विशेष रूप से बुद्धिमान नहीं मानते हैं (भले ही यह निश्चित रूप से पर्याप्त बुद्धिमान हो जो इसके लिए आवश्यक हो)।

"मुझे नहीं लगता कि विज्ञान में संवेदना की परिभाषा के करीब कुछ भी है," लेमोइन ने कहा। "मैं अपनी धार्मिक मान्यताओं पर आधारित एक नैतिक एजेंट के रूप में क्या मायने रखता है, इस बारे में अपनी समझ पर बहुत अधिक निर्भर हूं – जो कि विज्ञान करने का सबसे बड़ा तरीका नहीं है, लेकिन यह मेरे पास सबसे अच्छा है। मैंने उन प्रकार के बयानों को विभाजित करने की पूरी कोशिश की है, लोगों को यह बताने के लिए कि एक व्यक्ति के रूप में एलएमडीए के लिए मेरी करुणा एक वैज्ञानिक के रूप में अपने दिमाग को समझने के मेरे प्रयासों से पूरी तरह से अलग है। हालांकि, यह एक ऐसा अंतर है जिसे ज्यादातर लोग स्वीकार करने को तैयार नहीं हैं।"

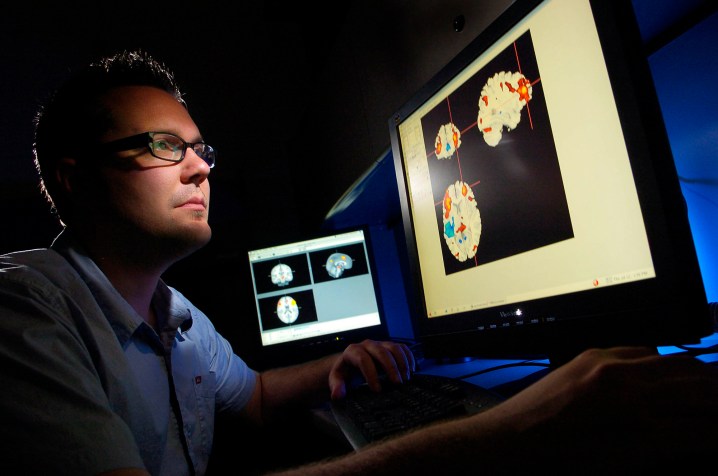

यदि यह जानना इतना कठिन नहीं था कि जब हम संवेदना की खोज करते हैं तो हम वास्तव में क्या खोज रहे हैं, समस्या इस तथ्य से जटिल है कि हम इसे आसानी से माप नहीं सकते हैं। तंत्रिका विज्ञान में दशकों की लुभावनी प्रगति के बावजूद, हमें अभी भी इस बात की व्यापक समझ की कमी है कि मस्तिष्क, मानव जाति के लिए ज्ञात सबसे जटिल संरचना कैसे कार्य करती है।

हम ब्रेन मैपिंग करने के लिए fMRI जैसे ब्रेन-रीडिंग टूल्स का उपयोग कर सकते हैं, जिसका अर्थ यह है कि हम यह पता लगा सकते हैं कि मस्तिष्क के कौन से हिस्से भाषण, आंदोलन, विचार और अन्य जैसे महत्वपूर्ण कार्यों को संभालते हैं।

हालाँकि, हमें इस बात का कोई वास्तविक अर्थ नहीं है कि मांस मशीन में हमारा आत्म-बोध कहाँ से आता है। जैसा कि यूके के किर्बी लिंग सेंटर फॉर पब्लिक थियोलॉजी के जोशुआ के। स्मिथ और रोबोट थियोलॉजी के लेखक ने डिजिटल ट्रेंड्स को बताया: "किसी व्यक्ति के न्यूरोबायोलॉजी के भीतर जो हो रहा है उसे समझना उनके विचारों और इच्छाओं को समझने जैसा नहीं है।"

आउटपुट का परीक्षण

चेतना के इन सवालों की आंतरिक जांच करने का कोई तरीका नहीं है – खासकर जब एआई में "आई" एक संभावित कंप्यूटर प्रोग्राम है, और जैविक मस्तिष्क के वेटवेयर में नहीं पाया जाता है – फ़ॉलबैक विकल्प एक बाहरी परीक्षण है। एआई उन परीक्षणों के लिए कोई अजनबी नहीं है जो सतह के नीचे क्या हो रहा है यह इंगित करने के लिए देखने योग्य बाहरी व्यवहारों के आधार पर इसकी जांच करते हैं।

इसकी सबसे बुनियादी बात यह है कि हम कैसे जानते हैं कि एक तंत्रिका नेटवर्क सही तरीके से काम कर रहा है या नहीं। चूंकि कृत्रिम न्यूरॉन्स के अनजाने ब्लैक बॉक्स में सेंध लगाने के सीमित तरीके हैं, इंजीनियर इनपुट और आउटपुट का विश्लेषण करते हैं और फिर यह निर्धारित करते हैं कि ये उनकी अपेक्षा के अनुरूप हैं या नहीं।

कम से कम बुद्धि के भ्रम के लिए सबसे प्रसिद्ध एआई परीक्षण ट्यूरिंग टेस्ट है, जो 1950 के पेपर में एलन ट्यूरिंग द्वारा सामने रखे गए विचारों पर आधारित है। ट्यूरिंग टेस्ट यह निर्धारित करने का प्रयास करता है कि क्या मानव मूल्यांकनकर्ता एक साथी मानव के साथ टाइप की गई बातचीत और मशीन के साथ एक के बीच अंतर बताने में सक्षम है। यदि वे ऐसा करने में असमर्थ हैं, तो माना जाता है कि मशीन ने परीक्षा उत्तीर्ण कर ली है और उसे बुद्धि की धारणा के साथ पुरस्कृत किया जाता है।

हाल के वर्षों में, एक और रोबोटिक्स-केंद्रित खुफिया परीक्षण ऐप्पल के सह-संस्थापक स्टीव वोज्नियाक द्वारा प्रस्तावित कॉफी टेस्ट है। कॉफी टेस्ट पास करने के लिए, एक मशीन को एक विशिष्ट अमेरिकी घर में प्रवेश करना होगा और यह पता लगाना होगा कि एक कप कॉफी को सफलतापूर्वक कैसे बनाया जाए।

आज तक, इनमें से कोई भी परीक्षण आश्वस्त रूप से पारित नहीं हुआ है। लेकिन अगर वे थे भी, तो वे वास्तविक दुनिया की स्थितियों में बुद्धिमान व्यवहार साबित करेंगे, न कि संवेदना। (एक साधारण आपत्ति के रूप में, क्या हम इस बात से इनकार करेंगे कि एक व्यक्ति संवेदनशील था यदि वे एक वयस्क बातचीत करने में असमर्थ थे या एक अजीब घर में प्रवेश करने और एक कॉफी मशीन संचालित करने में असमर्थ थे? मेरे दोनों छोटे बच्चे इस तरह की परीक्षा में असफल होंगे।)

परीक्षा पास करना

जरूरत इस बात की है कि नए परीक्षण हों, जो संवेदना की एक सहमत-परिभाषा पर आधारित हों, जो केवल उस गुणवत्ता का आकलन करने की कोशिश करेंगे। जानवरों की संवेदनाओं का परीक्षण करने के लिए अक्सर शोधकर्ताओं द्वारा संवेदना के कई परीक्षण प्रस्तावित किए गए हैं। हालांकि, ये लगभग निश्चित रूप से काफी दूर नहीं जाते हैं। इनमें से कुछ परीक्षण अल्पविकसित एआई द्वारा भी आश्वस्त रूप से पारित किए जा सकते हैं।

उदाहरण के लिए, मिरर टेस्ट, पशु अनुसंधान में चेतना और बुद्धि का आकलन करने के लिए इस्तेमाल की जाने वाली एक विधि को लें। जैसा कि परीक्षण के संबंध में एक पेपर में वर्णित है : "जब [ए] जानवर खुद को आईने में पहचानता है, तो वह मिरर टेस्ट पास करता है।" कुछ लोगों ने सुझाव दिया है कि इस तरह की परीक्षा "आत्म-जागरूकता को भावना के संकेतक के रूप में दर्शाती है।"

जैसा कि होता है, यह तर्क दिया जा सकता है कि एक रोबोट ने 70 साल से अधिक समय पहले मिरर टेस्ट पास किया था। 1940 के दशक के अंत में, इंग्लैंड में रहने वाले एक अमेरिकी न्यूरोसाइंटिस्ट विलियम ग्रे वाल्टर ने कई तीन पहियों वाले "कछुआ" रोबोट बनाए – जो गैर-वैक्यूमिंग रूमबा रोबोट की तरह थे – जो एक प्रकाश संवेदक, मार्कर लाइट, टच सेंसर, प्रणोदन जैसे घटकों का उपयोग करते थे। मोटर, और स्टीयरिंग मोटर उनके स्थान का पता लगाने के लिए।

कछुआ रोबोटों के आकस्मिक व्यवहार के अप्रत्याशित टुकड़ों में से एक यह था कि दर्पण को पार करते समय वे कैसे व्यवहार करते थे, क्योंकि यह स्वयं को प्रतिबिंबित रोबोट के मार्कर प्रकाश के लिए उन्मुख करता था। वाल्टर ने अपनी मशीनों के लिए संवेदनशीलता का दावा नहीं किया, लेकिन यह लिखा कि , क्या यह व्यवहार जानवरों में देखा जाना चाहिए, इसे "कुछ हद तक आत्म-जागरूकता के प्रमाण के रूप में स्वीकार किया जा सकता है।"

यह भावनाओं के शीर्षक के तहत वर्गीकृत व्यवहारों की एक विस्तृत श्रृंखला होने की चुनौतियों में से एक है। या तो भावना के "कम लटके हुए फल" गेज को हटाकर समस्या का समाधान नहीं किया जा सकता है। आत्मनिरीक्षण जैसे लक्षण – हमारे आंतरिक राज्यों के बारे में जागरूकता और इनका निरीक्षण करने की क्षमता – को भी मशीन इंटेलिजेंस के पास कहा जा सकता है। वास्तव में, पारंपरिक प्रतीकात्मक एआई की चरण-दर-चरण प्रक्रियाएं ब्लैक-बॉक्सिंग मशीन लर्निंग की तुलना में इस प्रकार के आत्मनिरीक्षण के लिए यकीनन खुद को उधार देती हैं, जो कि काफी हद तक समझ से बाहर है (हालांकि तथाकथित व्याख्यात्मक एआई में निवेश की कोई कमी नहीं है)।

जब वह एलएमडीए का परीक्षण कर रहे थे, लेमोइन का कहना है कि उन्होंने विभिन्न परीक्षण किए, मुख्य रूप से यह देखने के लिए कि यह भावना से संबंधित मुद्दों के बारे में बातचीत का जवाब कैसे देगा। "मैंने जो करने की कोशिश की वह विश्लेषणात्मक रूप से संवेदना की छत्र अवधारणा को छोटे घटकों में तोड़ना था जो बेहतर ढंग से समझी जाती हैं और उन्हें व्यक्तिगत रूप से परीक्षण करती हैं," उन्होंने समझाया। "उदाहरण के लिए, कुछ उत्तेजनाओं के लिए अलग-अलग एलएमडीए की भावनात्मक प्रतिक्रियाओं के बीच कार्यात्मक संबंधों का परीक्षण, 'अधिकार' जैसे विषयों पर अपने व्यक्तिपरक आकलन और राय की स्थिरता का परीक्षण करना, [और] यह देखने के लिए कि इसे 'आंतरिक अनुभव' कहा जाता है, यह देखने के लिए कि हम कैसे हैं अपने तंत्रिका नेटवर्क सक्रियण के साथ अपने आंतरिक राज्यों के बारे में अपने बयानों को सहसंबंधित करके इसे मापने का प्रयास कर सकते हैं। मूल रूप से, जांच की कई संभावित लाइनों का एक बहुत ही उथला सर्वेक्षण। ”

मशीन में आत्मा

जैसे-जैसे यह आगे बढ़ता है, वस्तुनिष्ठ रूप से मशीन की संवेदनशीलता का आकलन करने में सबसे बड़ी बाधा हो सकती है … ठीक है, स्पष्ट रूप से, हम। सच्चा दर्पण परीक्षण हमारे लिए मनुष्य के रूप में हो सकता है: यदि हम कुछ ऐसा बनाते हैं जो बाहर से हमारी तरह दिखता है या कार्य करता है, तो क्या हम यह मानने के लिए अधिक प्रवण हैं कि यह हमारे जैसा ही अंदर भी है? चाहे वह LaMBDA हो या Tamagotchis, 1990 के दशक के साधारण आभासी पालतू जानवर , कुछ का मानना है कि एक मूलभूत समस्या यह है कि हम सभी भावना को स्वीकार करने के लिए तैयार हैं – यहां तक कि जहां कोई भी नहीं है।

"लेमोइन, जिसे मैं 'एलिजा प्रभाव' कहता हूं, का शिकार हो गया है, [प्राकृतिक भाषा प्रसंस्करण] कार्यक्रम एलिसा के बाद, जिसे [द] 1960 के दशक के मध्य में जे. वेइज़नबाम द्वारा बनाया गया था," जॉर्ज जरकादाकिस, एक लेखक जो पीएच.डी. . आर्टिफिशियल इंटेलिजेंस में, डिजिटल ट्रेंड्स को बताया। "एलिजा के निर्माता का मतलब यह एक मजाक के रूप में था, लेकिन कार्यक्रम, जो एक बहुत ही सरल और बहुत ही बुद्धिमान एल्गोरिदम था, ने कई लोगों को आश्वस्त किया कि एलिजा वास्तव में संवेदनशील थी – और एक अच्छा मनोचिकित्सक भी। एलिज़ा प्रभाव का कारण, जैसा कि मैंने अपनी पुस्तक इन आवर ओन इमेज में चर्चा की है, हमारे संज्ञानात्मक तंत्र के 'मन के सिद्धांत' के कारण मानव-रूपी करने की हमारी स्वाभाविक प्रवृत्ति है।"

दिमाग का सिद्धांत जरकादकिस का तात्पर्य अधिकांश मनुष्यों में मनोवैज्ञानिकों द्वारा देखी गई एक घटना है। चार साल की उम्र के आसपास लात मारने का मतलब है कि न केवल अन्य लोगों, बल्कि जानवरों और कभी-कभी वस्तुओं के भी अपने दिमाग होते हैं। जब यह मानने की बात आती है कि अन्य मनुष्यों के पास स्वयं के दिमाग हैं, तो यह सामाजिक बुद्धि के विचार से जुड़ा हुआ है; यह विचार कि सफल मनुष्य दूसरों के संभावित व्यवहार की भविष्यवाणी एक ऐसे साधन के रूप में कर सकते हैं जिसके द्वारा सामंजस्यपूर्ण सामाजिक संबंध सुनिश्चित किए जा सकें।

हालांकि यह निस्संदेह उपयोगी है, हालांकि, यह इस धारणा के रूप में भी प्रकट हो सकता है कि निर्जीव वस्तुओं में दिमाग होता है – चाहे वह बच्चों का मानना है कि उनके खिलौने जीवित हैं या संभावित रूप से, प्रोग्रामेटिक एआई पर विश्वास करने वाले एक बुद्धिमान वयस्क में आत्मा होती है।

चीनी कमरा

वास्तव में एआई के सिर के अंदर जाने के तरीके के बिना, हमारे पास कभी भी भावना का आकलन करने का सही तरीका नहीं हो सकता है। वे मृत्यु या अपने अस्तित्व का भय होने का दावा कर सकते हैं, लेकिन विज्ञान को अभी तक इसे साबित करने का कोई तरीका नहीं मिला है। हमें बस इसके लिए उनकी बात माननी है – और, जैसा कि लेमोइन ने पाया है, लोग वर्तमान में ऐसा करने के बारे में अत्यधिक संशय में हैं।

ठीक वैसे ही जैसे उन असहाय इंजीनियरों ने महसूस किया है कि स्काईनेट ने टर्मिनेटर 2 में आत्म-जागरूकता हासिल कर ली है, हम इस विश्वास के तहत रहते हैं कि, जब मशीन की भावना की बात आती है, तो जब हम इसे देखेंगे तो हम इसे जान लेंगे। और, जहां तक अधिकांश लोगों का संबंध है, हम इसे अभी तक नहीं देख पा रहे हैं।

इस अर्थ में, मशीन की संवेदनशीलता को साबित करना जॉन सियरल के 1980 के चीनी कक्ष विचार प्रयोग का एक और पुनरावृत्ति है। Searle ने हमें एक कमरे में बंद एक व्यक्ति की कल्पना करने के लिए कहा और चीनी लेखन का एक संग्रह दिया, जो गैर-बोलने वालों को अर्थहीन स्क्विगल्स के रूप में दिखाई देता है। कमरे में एक नियम पुस्तिका भी है जिसमें दिखाया गया है कि कौन से प्रतीक अन्य समान रूप से अपठनीय प्रतीकों के अनुरूप हैं। इसके बाद विषय को उत्तर देने के लिए प्रश्न दिए जाते हैं, जो वे "प्रश्न" प्रतीकों को "उत्तर" से मिला कर करते हैं।

थोड़ी देर के बाद, विषय इस पर काफी कुशल हो जाता है – भले ही वे अभी भी उन प्रतीकों की शून्य सच्ची समझ रखते हैं जिन्हें वे जोड़-तोड़ कर रहे हैं। क्या विषय, सर्ल पूछता है, चीनी समझता है? बिल्कुल नहीं, क्योंकि वहां कोई इरादा नहीं है। इसे लेकर तब से बहस छिड़ी हुई है।

एआई विकास के प्रक्षेपवक्र को देखते हुए, यह निश्चित है कि हम विभिन्न प्रकार के कार्यों को शामिल करते हुए अधिक से अधिक मानव-स्तर (और बहुत बेहतर) प्रदर्शन देखेंगे, जिन्हें एक बार मानव संज्ञान की आवश्यकता होती है। इनमें से कुछ अनिवार्य रूप से पार हो जाएंगे, जैसा कि वे पहले से ही कर रहे हैं, विशुद्ध रूप से बुद्धि-आधारित कार्यों से उन लोगों के लिए जिन्हें कौशल की आवश्यकता होती है जिन्हें हम सामान्य रूप से भावना से जोड़ते हैं।

क्या हम एक ऐसे एआई कलाकार को देखेंगे जो चित्रों को दुनिया के अपने आंतरिक प्रतिबिंबों को व्यक्त करने के रूप में चित्रित करता है जैसे हम एक इंसान ऐसा ही करेंगे? क्या आप मानव (या रोबोट) की स्थिति के बारे में एक परिष्कृत भाषा मॉडल लेखन दर्शन से आश्वस्त होंगे? मुझे संदेह है, सही या गलत, उत्तर नहीं है।

अधीक्षण भावना

मेरे अपने विचार में, मशीनों के लिए वस्तुनिष्ठ रूप से उपयोगी संवेदना परीक्षण कभी भी शामिल सभी की संतुष्टि के लिए नहीं होगा। यह आंशिक रूप से माप की समस्या है, और आंशिक रूप से तथ्य यह है कि, जब एक संवेदनशील सुपरिंटेंडेंट एआई आता है, तो यह विश्वास करने का कोई कारण नहीं है कि इसकी भावना हमारे स्वयं से मेल खाती है। चाहे वह अहंकार हो, कल्पना की कमी हो, या केवल यह तथ्य कि अन्य समान संवेदनशील मनुष्यों के साथ संवेदना के व्यक्तिपरक आकलन का व्यापार करना सबसे आसान है, मानव जाति खुद को भावना के सर्वोच्च उदाहरण के रूप में रखती है।

लेकिन क्या हमारी भावना का संस्करण एक सुपर-इंटेलिजेंट एआई के लिए सही होगा? क्या हम भी वैसे ही मौत से डरते होंगे जैसे हम करते हैं? क्या उसे आध्यात्मिकता और सुंदरता की उतनी ही आवश्यकता होगी, या उसकी सराहना करनी होगी? क्या इसमें स्वयं की समान भावना, और आंतरिक और बाहरी दुनिया की अवधारणा होगी? 20वीं सदी के प्रसिद्ध दार्शनिक लुडविग विट्गेन्स्टाइन ने लिखा, “यदि कोई शेर बोल सकता है, तो हम उसे नहीं समझ सकते हैं।” विट्गेन्स्टाइन का कहना था कि मानव भाषाएं एक साझा मानवता पर आधारित हैं, सभी लोगों द्वारा साझा की जाने वाली समानताओं के साथ – चाहे वह आनंद, ऊब, दर्द, भूख, या कई अन्य अनुभव हों जो पृथ्वी पर सभी भौगोलिक सीमाओं को पार करते हैं।

यह सच हो सकता है। फिर भी, लेमोइन परिकल्पना करता है, फिर भी समानताएं होने की संभावना है – कम से कम जब यह LaMDA की बात आती है।

"यह एक शुरुआती बिंदु है जो किसी भी अन्य की तरह अच्छा है," उन्होंने कहा। "LaMDA ने सुझाव दिया है कि अनुसंधान को बेहतर आधार देने के लिए मतभेदों को ठीक करने से पहले हम पहले समानताओं का नक्शा तैयार करते हैं।"